近日

DeepSeek团队发表新论文

论文以DeepSeek-V3为焦点案例

披露其于AI硬件架构

与模子设计方面的要害立异

为实现具备成本效益的

年夜范围练习及推理提供思绪

论文显示

DeepSeek开创人兼CEO梁文锋

也是介入者之一

DeepSeek论文《深切解读 DeepSeek-V3:AI 架构的扩大挑战与硬件思索》

图源:论文截图

有业内子士暗示

该论文聚焦“硬件-模子”

协同立异底层逻辑

直击当前年夜模子练习

与推理的效率痛点

一路来看↓

揭秘DeepSeek模子设计原则

于练习年夜模子这条路上

可以说一直有“三浩劫题”

内存不敷用

计较效率低

通讯速率慢

而这篇论文所要解决的

恰是上述的这些问题

与此前发布的V3技能陈诉差别

这篇论文具体论述了DeepSeek

怎样做到于硬件资源的“紧箍咒”下

经由过程精妙的“软硬一体”协同设计

将成本效益这笔账算好

DeepSeek于论文中提到

本文的目的不是重申

DeepSeek-V3的具体架谈判算法细节

是超过硬件架谈判模子设计

采用两重视角来摸索它们之间

扑朔迷离的彼此作用

以实现具备成本效益的

年夜范围练习及推理

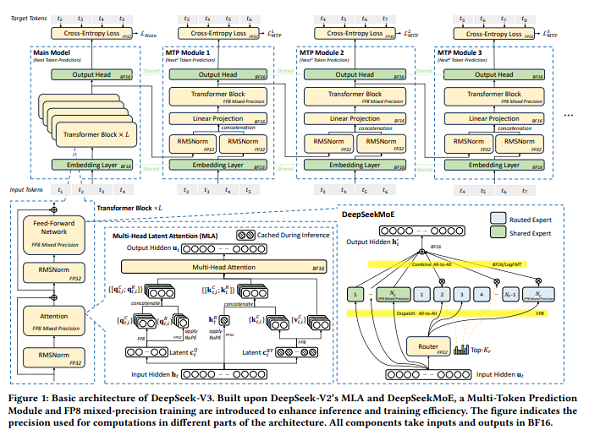

DeepSeek-V3的基本架构

图源:论文截图

详细而言

论文聚焦内存效率、成本节制、

推理速率等方面睁开申明

DeepSeek模子设计原则

于内存效率方面

多头潜于留意力(MLA)技能

经由过程压缩键值(KV)缓存

缓存显著降低了内存耗损

FP8混淆精度练习技能

将内存耗损显著降低了一半

从数据来看

比拟其他模子

(如LLaMA-三、Qwen-2.5)

DeepSeek-V3的KV缓存巨细

每一token仅需70 KB

是传统要领的1/7到1/4

年夜幅降低显存压力

特别合适长文本处置惩罚

于成本节制方面

DeepSeek开发了DeepSeek MoE架构

其两年夜上风包括降低练习成本

及利在小我私家利用及当地部署

于提高推理速率方面

DeepSeek-V3采用的是

多token猜测(MTP)的要领

传统模子每一次只能天生1个token

而MTP经由过程轻量级子模子并行

猜测多个候选token

验证后选择最优成果

试验效果显示

天生速率晋升1.8倍

OpenAI结合开创人

Andrej Karpathy此前惊叹

“DeepSeek-V3的呈现

实现了高机能与低成本的均衡

将来也许不需要

超年夜范围的GPU集群了”

六年夜要害摸索将来AI基础举措措施

下一代AI基础举措措施

将怎样进级?

DeepSeek从硬件架构的角度

提出六年夜标的目的

触及内存、互连、收集、

计较等焦点范畴

图源:虎嗅

总体来看,包括

“鲁棒性优先:

构建不容易瓦解的练习体系”

“倾覆互连架构:

CPU-GPU直连消弭节点瓶颈”

“智能收集进级:

动态路由实现低延迟”

“通讯挨次‘硬件化’:

消弭软件分外开消”

“收集计较交融:

硬件加快通讯效率”

“内存架构重构:

从‘芯片重叠’到‘晶圆集成’”

这些专业名词

非里手乍一看有些难明

有业内子士“翻译”称

就是下一代AI硬件要向

算数快(低精度计较+当地细粒器量化)

传话快(直连收集+智能路由)

记性好(3D内存+近存计较)

不宕机(自愈收集)的标的目的改良

才能更好地运用在年夜模子练习

实现高效扩大

图源:收集

DeepSeek暗示

这些内存中央的架构立异

旨于打破当前内存成长

滞后在模子范围扩张的瓶颈

是下一代AI体系连续迈向

“更年夜、更快、更稳”的要害路径之一

同时这些方案也于DeepSeek-V3

练习与推理实践中均取患了实效

为下一代高机能AI体系

构建了坚实的内存支撑基础

参考:上海证券报、财联社、量子位

撰文:雷渺鑫 编纂:李飞 排版:李汶键 兼顾:李政葳

-710公海寰宇